新华网评AI换脸诈骗 换脸骗术升级,警惕亲人被骗

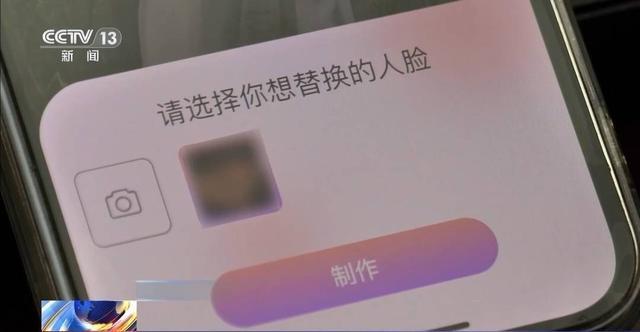

一张静态照片借助人工智能技术,可以转化为看似真实的亲友对话场景。近期,一位名叫“滤镜粉碎机”的博主,仅用15秒的AI换脸视频,在三小时内便“说服”了一位团队成员的母亲转账两万元,此事迅速在网络上引发了广泛关注和讨论。随着AI技术的进步,人们越来越担忧不法分子利用这一技术,通过融合他人面孔和声音来制造高仿真度的虚假内容进行诈骗。这类担忧并非空穴来风,中央广播电视总台在2024年的3·15晚会上就揭露了利用“AI换脸”实施诈骗的行为。根据过往调查,约60%的受访者承认难以仅凭肉眼分辨出AI换脸视频的真伪。

在“滤镜粉碎机”的试验中,通过一个虚构的紧急情况——“儿子的女友怀孕需要医疗费”,成功让团队成员的母亲在儿子电话无法接通的情况下,几经犹豫最终转账。这个案例突显出,即便是理智的成年人,在情感驱使下也可能落入AI诈骗的陷阱。博主透露,团队选择相对温和的借口进行测试,却发现即便是这样,父母在看到孩子“真实”的影像后,也会因担忧而失去部分判断力。

对于如何识破AI换脸的诡计,博主建议通过连续提问私密问题的方式,因为即便AI技术再先进,也难以完全复制个人间独有的生活细节。此外,技术专家指出,观察面部轮廓和光线的异常也是辨别AI换脸的一个方法,尤其是在要求对方做出快速头部动作时。

法律界人士强调,利用AI技术进行诈骗或未经授权的肖像替换均触犯法律,不仅构成诈骗罪,也可能侵犯个人的肖像权和隐私权。因此,合理规范AI技术的使用,提升防御技术,以及增强公众的防骗意识显得尤为重要。博主“滤镜粉碎机”呼吁行业内外共同关注AI防御技术的发展,同时提醒公众应提高个人信息保护意识,对于易受骗群体则需加强宣传教育,共同努力遏制AI技术的不当使用。

免责声明:本文章由会员“极目新闻”发布如果文章侵权,请联系我们处理,本站仅提供信息存储空间服务如因作品内容、版权和其他问题请于本站联系